Tradicionalmente, la IA generativa ha tenido una relación complicada con el desarrollo de los videojuegos: compromete puestos de trabajo de creadores reales y empobrece la calidad final de apartados como el arte o la traducción/localización. Dicho esto, hace unas semanas pude viajar hasta San Francisco para entrar de lleno en la GDC 2025 y ver de primera mano cómo se ve la misma herramienta “desde el otro lado” en la industria triple-A.

Por si no estabas familiarizado con el tema, la Game Developers Conference es un evento diseñado por y para desarrolladores de videojuegos en lugar de para los consumidores; razón por la que ahí no se muestran nuevos tráilers ni se programan anuncios que afecten directamente al usuario final. En lugar de eso, numerosos estudios participantes ofrecen charlas, paneles y talleres a cualquier interesado en aprender o pulir conocimientos de numerosas áreas del mundillo.

Siendo un evento que reúne a artistas, programadores, especialistas de marketing y más, no es extraño que grandes compañías como Nvidia aprovechen la ocasión para actualizar o reforzar su popularidad entre los hacedores de videojuegos mostrando toda clase de progresos tecnológicos. Este año, por ejemplo, los californianos de verde dieron el protagonismo a los sombreadores neurales que vimos en el CES 2025: modelos de IA aplicados en los ‘shaders’ y que en un futuro no muy lejano, posibilitarán gráficos mucho más complejos y detallados.

Generando animaciones editables

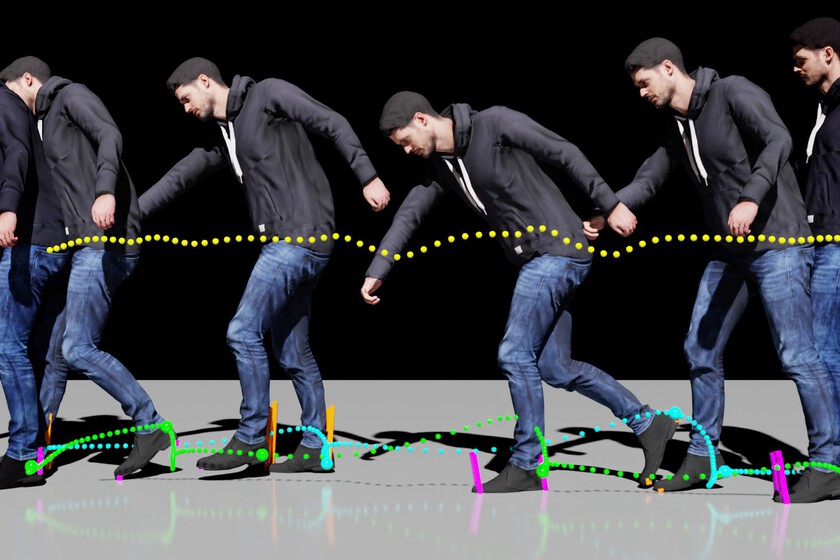

Una novedad completamente distinta, pero que me resultó bastante interesante, fue la que ellos llaman AI Body Motion —o sea, movimiento corporal generado por la inteligencia artificial— que se mostró en vivo y en directo en un evento propio de Nvidia que transcurría en paralelo en la ciudad. La idea, como su propio nombre indica, es generar animaciones para personajes de videojuego a partir de ‘prompts’ (instrucciones) que cualquiera puede escribir en unos segundos.

La demo que me enseñó Nvidia describía un personaje humanoide en un patio que hacía las veces de pista de obstáculos. Un representante de la compañía insertaba entonces ciertos comandos en una caja de texto: “camina, salta sobre el banco, agáchate y cruza la fuente sigilosamente”. En unos segundos, el motor gráfico ofrece hasta cuatro versiones de la secuencia animada que se le ha pedido, con pequeñas variaciones entre cada una de ellas. Siempre es posible generar más si ninguna convence al artista tras la pantalla.

¿Qué tal estuvo el resultado final? Pues un poco a medias: la animación en sí era bastante correcta, en la línea de lo que esperarías de un juego triple-A; pero siendo honestos, la IA generativa no deja de ser un autocompletador en esteroides sin el más mínimo ápice de carisma. O lo que es lo mismo, el resultado no está a la altura de lo que debería llegar a tiendas. Pero es que Nvidia tampoco lo presenta como un atajo o una solución fácil, sino más bien como un acelerador.

Las sesiones de captura de movimiento tradicionales requieren de espacios dedicados y mucha preparación. El año pasado, por ejemplo, visité las oficinas de Capcom en Osaka y en aquel momento los nipones estaban contentos de estar estrenando múltiples salones dedicados con más de 15 000 cámaras para grabar los movimientos tras Monster Hunter: Wilds, e incluso después de estas sesiones los animadores deben dedicar mucho esfuerzo a refinar los resultados.

Sesión de captura de movimiento en Capcom. Imagen: 3DJuegos

Ni que decir tiene que esta clase de inversiones están lejos del alcance de los estudios menos pudientes, e incluso aquellos que lo tienen tal vez necesiten grabar “algo rápido” de manera ocasional. Ahí es donde entra en juego el asunto de AI Body Motion, que es —o más bien debería ser— un acelerador en manos de humanos con mucho talento, entrenamiento y la capacidad de tener la última palabra sobre los resultados finales. La animación que produce esta funcionalidad no es un resultado servible para el juego, pero sí puede ser editada y refinada.

Las animaciones generadas no tienen encanto ni personalidad, pero sí pueden ayudar a estudios honrados a enriquecer sus mundos o reubicar sus presupuestos

Quiero decir, un adolescente de una banda delincuente suburbana en vaqueros no corre exactamente igual que un caballero cincuentón de la guardia real embutido en una armadura o un personaje cabezón de dibujos animados; de modo que incluso si este modelo de IA puede darte múltiples resultados para esa animación, al final del día hace falta que una persona entienda los matices y la personalidad de cada acción para darnos algo tan inmersivo como esperamos a nivel de usuario.

De la manera en la que yo lo veo, habrá estudios que hagan un mal uso de esta tecnología para saltarse a la torera buena parte del desarrollo; y también otros equipos más honestos que usen esto en paralelo al trabajo humano que hacen sus actores, animadores, ingenieros de software y productores para optimizar su línea de trabajo o (en palabras del mismo representante de Nvidia) redistribuir sus recursos monetarios y de tiempo. ¿Sería posible aumentar el número de animaciones para tu héroe si se terminasen en menos tiempo? ¿Y si ahora pudieses costear un mundo en el que los NPC están en constante movimiento?

Unreal Engine tiene 500+ animaciones gratis para desarrolladores, pero todos quieren las suyas propias.

Esto significa que habrá instancias en las que un proyecto necesite ponerse al día con su planificación para evitar un retraso, y otras en las que puedan destinar ciertos recursos extra a enriquecer el detalle de los NPC que vemos de fondo en una ciudad, por decir algo. Habrá que ver cómo se resuelve el asunto en el futuro, y en qué se traduce para la industria. Siendo cautelosamente optimista, recuerdo una entrevista con Bill Munk, director en Tripwire, donde me hablaba del estancamiento de la industria triple-A: tenemos muchos juegos clónicos.

Decía por aquel entonces que esto se debe no necesariamente a una falta de creatividad, sino más bien al hecho de que estos desarrollos son tan costosos y arriesgados que todo el mundo persigue las mismas fórmulas “de eficacia probada”. ¿La solución? En su opinión, es una cuestión de “que la tecnología avance” de tal manera que el trabajo se vuelva más eficiente y los costes se reduzcan, permitiendo a los estudios arriesgarse un poco más con sus ideas nuevas. Esperemos que esto se cumpla sin despedir a nadie en el proceso.

En 3DJuegos | NVIDIA da una muy buena noticia para quien quiera comprar una RTX 5000 y, por fin, bajará los precios en Europa

Deja una respuesta